Im Laufe der vergangenen Jahre haben sich die Fähigkeiten vierbeiniger Roboter permanent weiterentwickelt, u.a. auf schwierigen Terrains. Mobile Roboter eignen sich perfekt zur Durchführung von Inspektionen, sind aber von Natur aus nicht für Greifaufgaben geeignet. Häufig fügen Ingenieure, die an vierbeinigen Robotern arbeiten, externe Zubehörteile hinzu. Auf diese Weise lässt sich die Anzahl der Aufgaben, die dieser Typ Roboter ausführen kann, erhöhen. Genau das tun auch die Robotiker von Unitree Robotics, einem der führenden Unternehmen, wenn es um die Entwicklung von Roboterhunden geht. Mithilfe der KI sowie zahlreicher auf dem Markt verfügbarer Sensoren kann man einem Roboterhund von nun an beibringen, Gegenstände aufzuheben und auf Knöpfe zu drücken, aber auch komplexere Aufgaben ausführen.

Eine amerikanische Universität wendet die „einheitliche Richtlinie“ zum Koordinieren eines Manipulatorarms beim Roboter Go1 von Unitree Robotics an

Ein Roboterarm kann die Anzahl der möglichen Anwendungen vierbeiniger Roboter erhöhen.

Das Grundprinzip bei Vierbeinern mit einem Roboterarm besteht darin, dass das Gehen und das Greifen vom Controller einzeln verwaltet werden. Diese Methode ist nicht optimal. Sie erfordert viel Zeit und Mühe. Darüber hinaus ist die Gefahr groß, dass in verschiedenen Modulen Fehler auftreten und dass es zu ruckartigen Bewegungen kommt.

Um diesem Problem abzuhelfen, hat die Carnegie Mellon University in Pittsburgh beschlossen, Reinforcement Learning zu implementieren und ein System der einheitlichen Richtlinie zu testen, mit deren Hilfe sich das gesamte System (die vier Beine und der Arm) steuern lässt. Mithilfe dieser Methode lassen sich flüssigere und präzisere Bewegungen sowie eine bessere Arm-/Pfotenkoordination erzielen.

In diesem von 2 Studenten und ihrem Professor umgesetzten Projekt wurde der Roboter Go1 von Unitree Robotics verwendet, der für seine Zuverlässigkeit und seine hervorragende Performance bei geringem Investitionsaufwand bekannt ist. Am Roboter wurde der WidowX 250 Arm (6 Achsen) von Trossen Robotics angebracht.

Experimente haben demonstriert, dass das System der einheitlichen Richtlinie in verschiedenen Szenarien ein flinkes und dynamisches Verhalten erzielen lässt.

Mithilfe der „einheitlichen Richtlinie“ lässt sich ein flinkes und dynamisches Verhalten des Körpers und des Arms des Roboters erzielen.

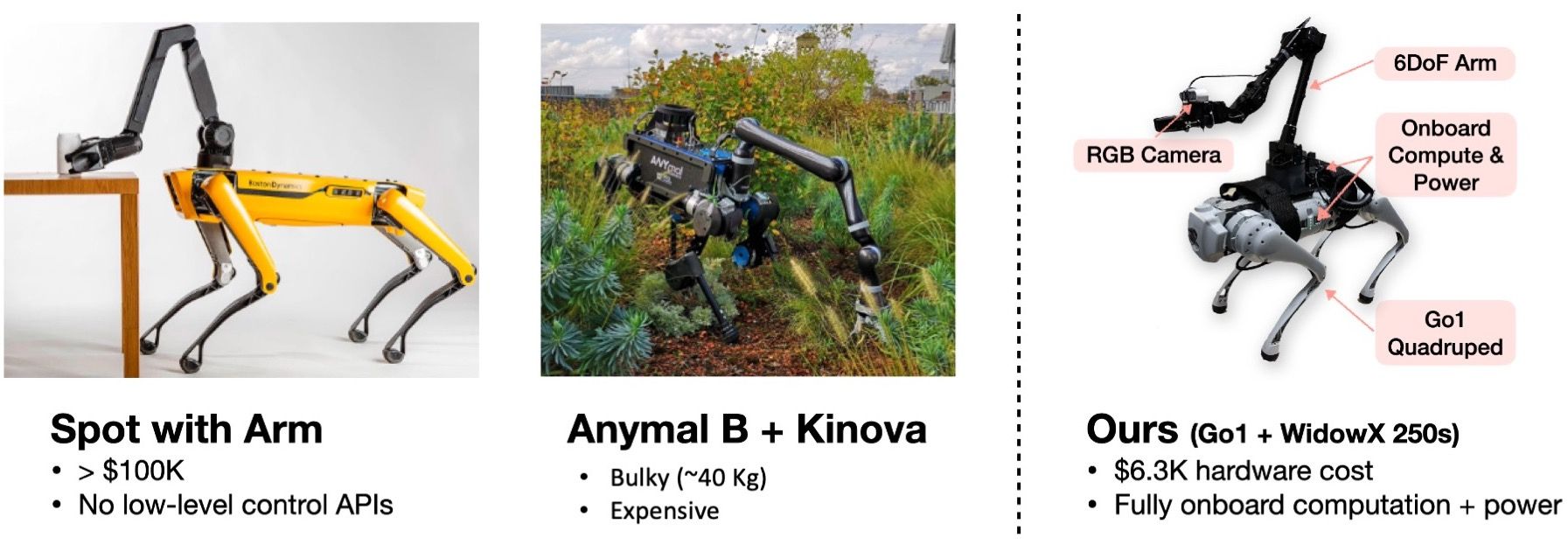

Vergleich

Gewerbliche Manipulatoren wie z.B. Boston Dynamics Spot mit Arm verlangen Universitäten und Forschungslaboren hohe Investitionen ab. Das Projektteam hat eine kostengünstigere Alternative gefunden, wobei sich die Forscher für die Marken Unitree Robotics und Trossen Robotics zur Entwicklung ihrer eigenen autonomen Plattform entschlossen.

Fernsteuerung

Die einheitliche Richtlinie ermöglicht die Steuerung aller Gelenke (12 Freiheitsgrade bei den Beinen und 6 Freiheitsgrade beim Arm) bei 50 Hz mit nur einem Raspberry Pi.

Die Software-Architektur des Arms WidowX 250s wird am NVIDIA Jetson des Roboterhunds Go1 dank den offiziellen Packs von Trossen Robotics installiert. Zum Gewährleisten der Kommunikation zwischen dem Raspberry Pi und dem NVIDIA Jetson wird das UDP Protokoll verwendet.

Das Öffnen und Schließen des Greifers sind nicht Teil der einheitlichen Richtlinie und werden im Rahmen verschiedener Fernsteuerungs-Experimente mithilfe eines Joysticks gesteuert. Beim Testen des Verhaltens basierend auf visueller Überwachung wird zur Steuerung des Greifers eine vorgegebene Richtlinie verwendet.

Mit dieser Kombination aus Reinforced Learning und der einheitlichen Richtlinie kann die Roboterplattform völlig unabhängig in 3 Betriebsmodi funktionieren: Fernsteuerung, visuelle Verfolgung und Wiederholung der Demonstrationen. Darüber hinaus kann der Roboter:

- Einen Stift in einen abseits stehenden Becher legen

- Einen Becher aufheben und diesen in einen hohen Mülleimer werfen

- Einen Gegenstand auf schwierigem Terrain aufheben

- Einen Knopf drücken, um ein Gebäude zu betreten

Visuelle Verfolgung

Der Roboter ist mit einer RealSense D435i Tiefenkamera von Intel für eine visuelle Verfolgung ausgestattet.

Der Roboter soll ein AprilTag verfolgen; die einheitliche Richtlinie passt die Steuerung des gesamten Körpers an, damit der Roboter dem AprilTag folgen kann. Wie man sehen kann, beugt der Roboter seine Pfoten in Koordination mit dem Arm, um die Kamera in der Nähe des AprilTags zu halten.

Wiederholung der Demonstrationen

Interessiert?

Unsere Forschungsabteilung kann sich mit zahlreichen innovativen Fragestellungen befassen, wie z.B. mit der Integration eines Manipulatorarms an einem autonomen oder teilautonomen Roboter. Wir haben vor kurzem kollaborative Arme bei 4 mobilen omnidirektionalen Robotern eingebaut: entdecken Sie unsere Kundenfall